Social Data à l’ere des chambres d’écho : Perspective d’une analyste

En 2024, l’influence des médias sociaux sur nos comportements ne fait aucun doute. Près de 64% de la population mondiale est active en ligne, évoluant dans un paysage numérique toujours en transformation. L’Insights Analyst joue un rôle crucial : il doit naviguer dans un océan de données issues des réseaux sociaux pour en extraire des informations pertinentes et exploitables, des insights précieux.

Mais attention : depuis le contenu que nous voyons, jusqu’aux commentaires qui apparaissent, les algorithmes qui façonnent nos expériences sur ces plateformes rendent essentiel de regarder au-delà de ce qui est présenté au premier coup d’œil.

Le défi des chambres d’écho et des perceptions biaisées

Imaginez-vous dans une salle aux miroirs, où chaque reflet renforce votre propre image. C’est ainsi que fonctionnent les chambres d’écho en ligne. Elles créent un environnement où nos opinions sont constamment amplifiées, donnant naissance à un phénomène psychologique trompeur : l’illusion que nos points de vue sont plus répandus qu’ils ne le sont réellement. Le résultat ? Une « illusion de la majorité » qui peut fausser notre compréhension de la réalité en ligne.

Pour comprendre véritablement le sentiment public, et comprendre les comportements des internautes, il est essentiel de comprendre ce biais des chambres d’écho qui influence l’émergence des tendances. Finalement les internautes analysés évoluent au sein de bulles déjà biaisées. Les analystes ne doivent pas se laisser emporter par ce même biais.

La quête d’une image fidèle des opinions en ligne

Actually I think having an ‘echo chamber’ on here isn’t a bad thing because many people’s opinions on here are simply wrong

— Jun (@likedbycats) December 27, 2023

Les deux biais cognitifs majeurs sont: « l’illusion de la majorité » et « l’effet de faux consensus ».

L’illusion de la majorité est un phénomène psychologique qui pousse les individus à croire que leurs opinions sont plus partagées qu’elles ne le sont en réalité. Cet effet est renforcé par l’exposition quasi exclusive à des contenus similaires aux nôtres, créant ce que l’on appelle des chambres d’écho. L' »illusion de la majorité » peut fausser notre compréhension, les voix les plus fortes et les plus visibles donnant souvent l’impression d’être majoritaires alors qu’elles ne le sont pas réellement.

Au-delà des contenus que nous voyons dans nos feeds, les algorithmes des plateformes peuvent aussi cibler quels commentaires sont vus au sujet de ce contenu. C’est ce que l’on appelle « l’effet de faux consensus » : il nous conforte dans l’idée que nos opinions sont non seulement valides, mais aussi largement partagées, alors qu’elles sont souvent marginales. Notre dépendance aux réseaux sociaux crée une réalité filtrée par les algorithmes.

Cela peut ainsi donner l’impression aux internautes que certaines opinions ou tendances sont plus répandues qu’elles ne le sont réellement. Parfois un décideur marketing/communication qui n’emploie pas d’outils de social listening peut se retrouver piégé par ces biais.

Face à cette réalité « filtrée » comment obtenir une vision objective des opinions et des tendances en ligne ?

Pour mieux appréhender la perception réelle d’un sujet, qu’il s’agisse d’une campagne, d’un produit ou d’une opinion, il est essentiel de reconnaître que notre vision personnelle du sujet ne constitue pas une image complète ou précise de la globalité du sujet. L’illusion de la majorité peut faire passer n’importe quelle opinion pour une tendance dominante, mais cela ne signifie pas qu’elle reflète l’opinion majoritaire.

En tant que dirigeant d’organisation, ou professionnel des insights, du marketing, de la communication… il est crucial de prendre en compte ce biais, pour

- remettre en question les récits rencontrés en ligne et rechercher activement des perspectives diverses

- éviter de considérer chaque tendance sur les réseaux sociaux comme un phénomène culturel global touchant tout le monde.

Les tendances peuvent être utiles pour concevoir des produits ou des campagnes de pub, mais pour les exploiter efficacement, il est nécessaire d’identifier les communautés en ligne spécifiques d’où elles émergent.

For the first noticeable time in our lives, extremely online culture is affecting above the line, real world marketing in a way that is IYKYK but also limiting bc it doesn't resonate to those outside of our digital echo chambers. An inversion of traditional media diffusion. https://t.co/VDZtNZxPds

— Michael J. Miraflor (@michaelmiraflor) August 13, 2024

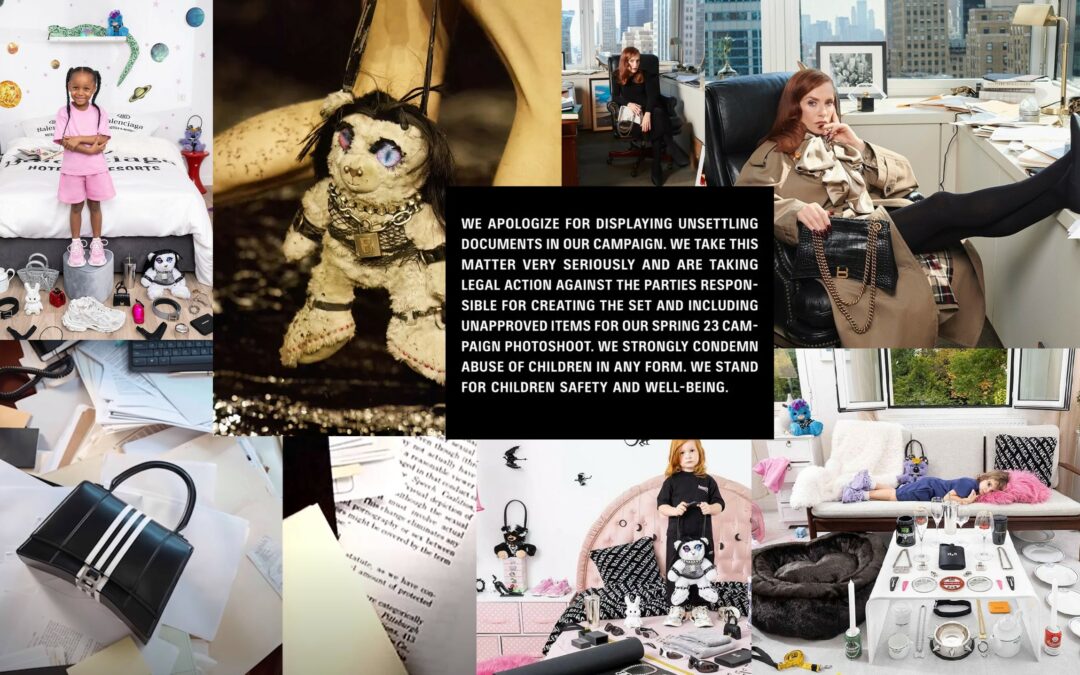

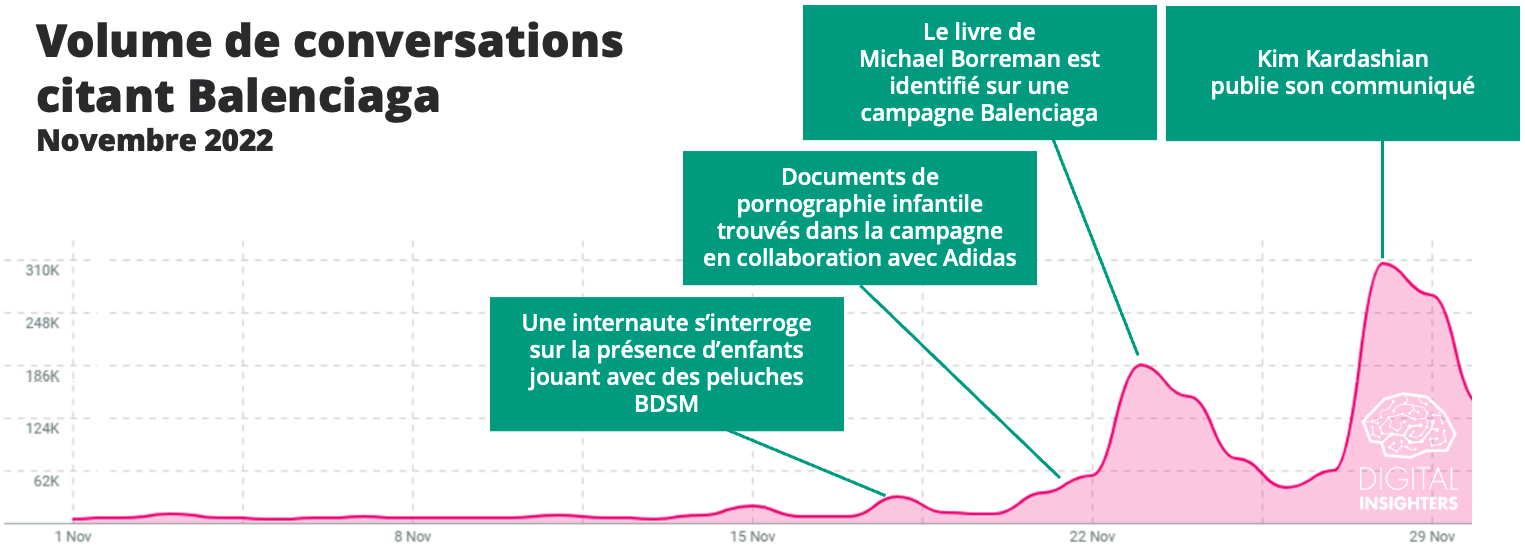

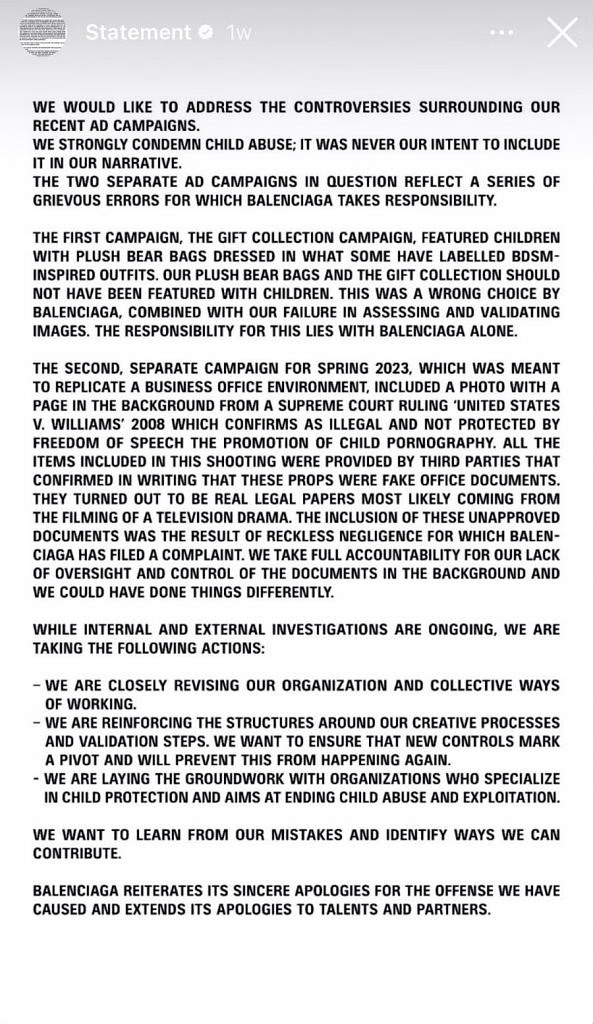

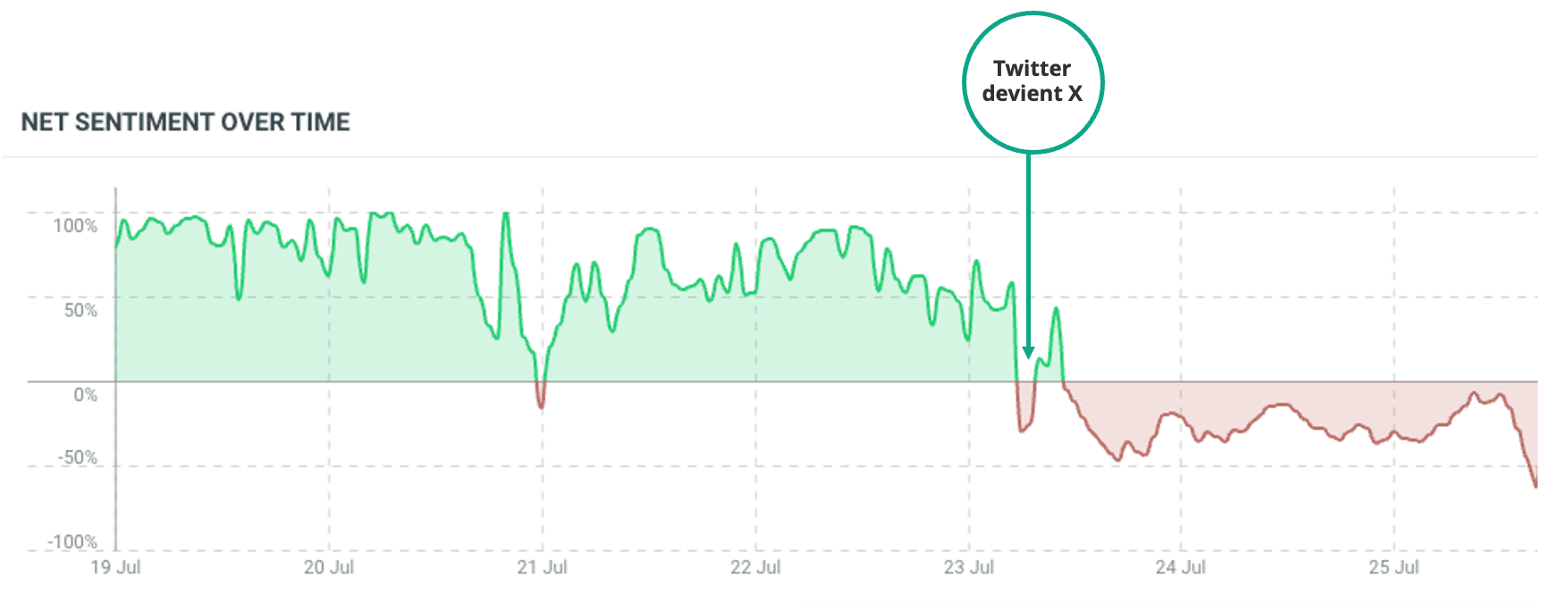

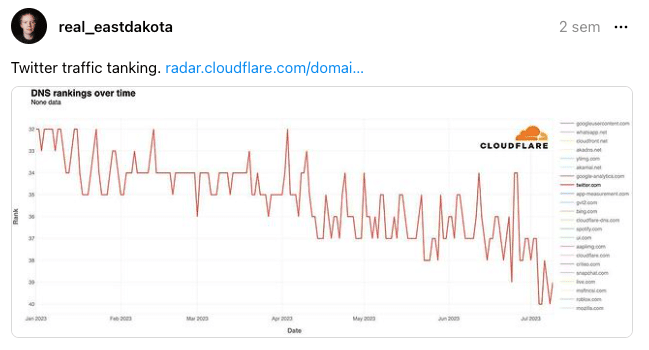

Certaines personnes choisissent de garder le silence en ligne sur des sujets controversés, alors que d’autres expriment leur opinion sur des thèmes plus ou moins sensibles. S’appuyer sur un faux consensus est un risque pour les marques. Cela peut rapidement passer d’un simple malentendu à une véritable crise de réputation.

Les dirigeants d’organisations et les professionnels du marketing ne devraient pas supposer que ce qu’ils observent reflète les perceptions de l’ensemble de leur public cible au risque de créer des campagnes qui manquent leur objectif. Pour créer lien authentique avec la cible d’une marque, il est crucial d’aller au-delà des apparences en menant des études approfondies sur les différentes communautés.

Dépasser les chambres d’écho : une méthode holistique

Pour relever ces défis, j’utilise une méthode en trois volets conçue pour capturer l’essence véritable des discussions en ligne. Il est essentiel de dépasser les chambres d’écho et de combiner différentes sources d’analyse. Voici une méthode structurée en trois volets qui permet de mieux comprendre l’ensemble des conversations et des perceptions :

01. Analyse des conversations en ligne :

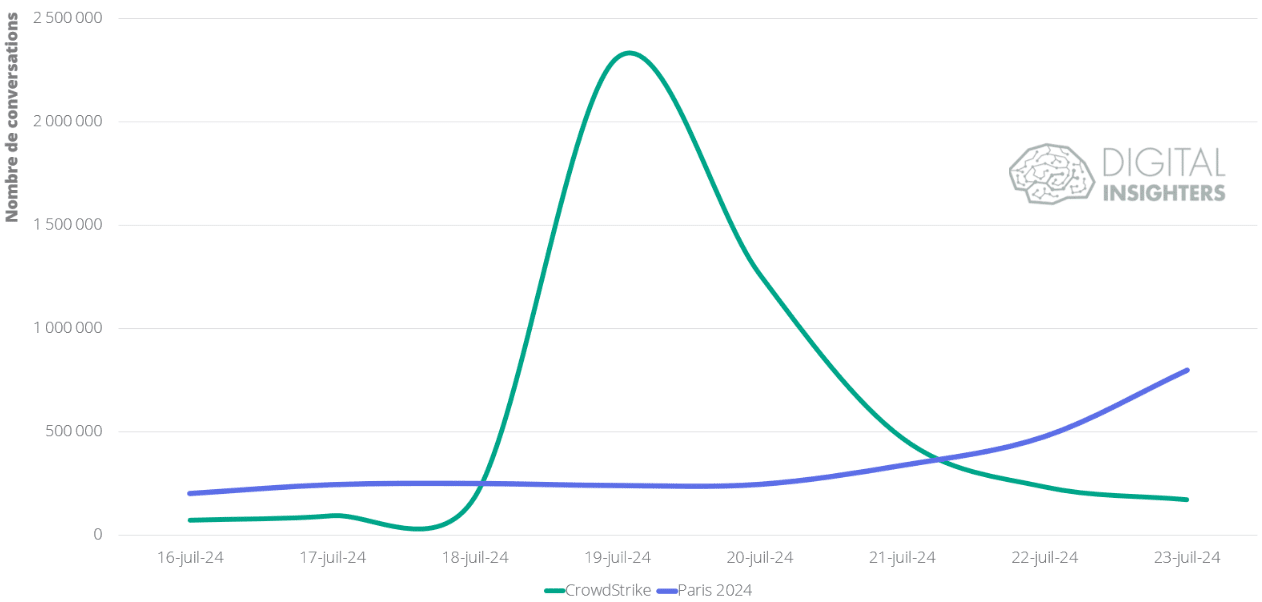

- Suivre les tendances dans le temps : identifier ce qui a fonctionné ou non, et pourquoi.

- Examiner les indicateurs clés : analyser non seulement la portée, l’engagement et le volume de publications, mais aussi le ton, le contenu et les émotions derrière chaque échange.

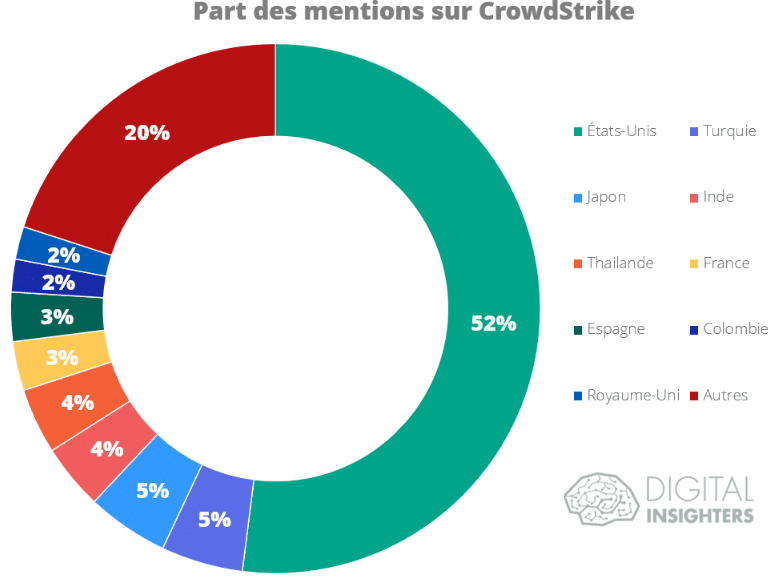

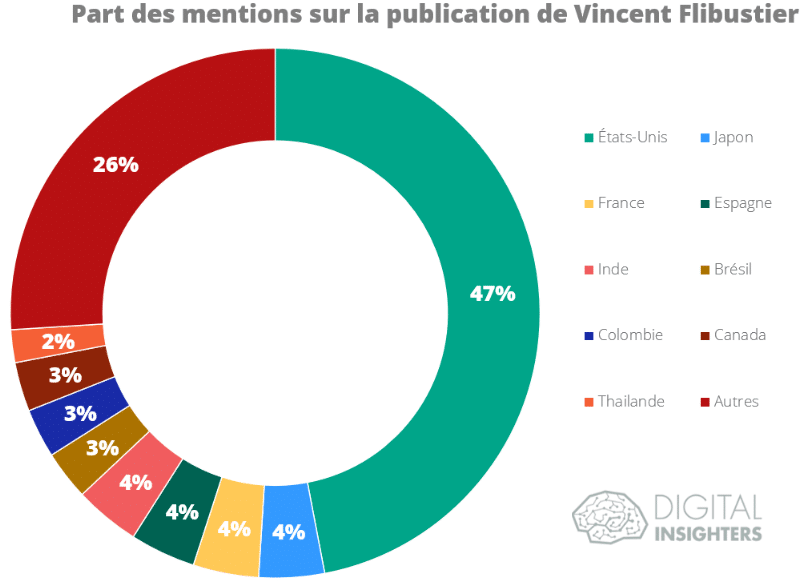

- Explorer les données démographiques des auteurs : elles fournissent des informations précieuses sur les communautés liées à des thèmes spécifiques, même si cela ne présente qu’une partie d’un ensemble plus large.

02. Comprendre l’audience et les communautés en son sein :

- Segmenter pour personnaliser : Utiliser les données comportementales pour adapter vos messages et offres, en créant un lien plus profond avec chaque communauté ou groupe.

- Identifier les opportunités : En explorant des segments sous-représentés, on peut non seulement étendre la portée mais aussi innover en fonction des attentes spécifiques de ces publics.

- Renforcer la fidélité : Une approche granulaire et ciblée vous permettra d’améliorer la pertinence de vos contenus et de bâtir une communauté fidèle autour de votre marque.

03. Exploiter les modèles de recherche :

- Anticiper les besoins non exprimés : Analyser les comportements de recherche (sur les moteurs de recherche) pour détecter les lacunes dans votre offre ou les questions non résolues.

- Comprendre les « audiences silencieuses » : Ces consommateurs qui interagissent peu ou pas avec la marque, mais qui recherchent de l’information sur les moteurs, peuvent fournir des informations essentielles sur leurs préoccupations et leurs attentes.

- Etre proactif : Exploiter ces insights permet d’anticiper les tendances émergentes et de prendre des décisions stratégiques avant vos concurrents.

Nous sommes convaincus que c’est en combinant ces 3 approches de manière holistique que l’on peut obtenir la vision la plus complète

L’équilibre est la clé. En combinant une vue d’ensemble des internautes avec une analyse fine des personnalités en ligne – y compris les discussions, les communautés, et les recherches – tout en tenant compte du contexte du monde réel, nous pouvons obtenir une image plus précise de la réalité des consommateurs et des parties prenantes.

Cette approche holistique permet d’aller au-delà du bruit généré par les groupes les plus visibles en ligne. Elle offre aux marques la possibilité de se connecter avec les audiences silencieuses, dont les voix sont souvent noyées dans le tumulte des médias sociaux.

En fin de compte, c’est cette compréhension nuancée et contextualisée qui permet aux marques de développer des stratégies qui résonnent véritablement avec leur public, tout en naviguant habilement dans les eaux parfois troubles des médias sociaux.

Si votre marque souhaite une vue équilibrée et complète des sujets d’intérêt affectant son organisation, et qui reflète mieux la complexité et la diversité de l’expérience de ses communautés en ligne, vous pouvez nous contacter. Nous proposons un accompagnement de vos équipes d’experts en appliquant notre approche holistique.